AI模型推理框架加速ONNXRuntime v1.23.2 最新免费版

软件大小:149MB

软件语言:简体中文

软件类别:应用工具

更新时间:2026-01-18 18:15:36

版本:v1.23.2 最新免费版

应用平台:Windows平台

- 软件介绍

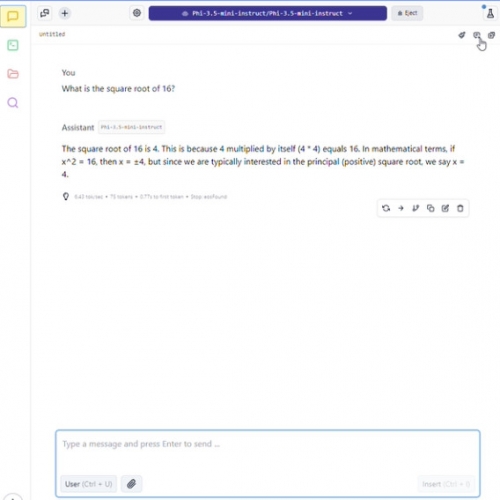

- 软件截图

- 相关软件

- 相关阅读

- 下载地址

ONNXRuntime v1.23.2最新免费版是一款强大的AI模型推理框架加速软件。它能显著提升推理速度,支持多平台和多种深度学习框架。我特别喜欢它的跨平台兼容性这一功能,以前在不同系统和硬件环境下运行模型很麻烦,常常需要做大量适配工作。有了ONNXRuntime v1.23.2,不管是Windows、Linux还是其他系统,都能轻松运行模型,大大提高了工作效率。

ONNX 运行时与不同的硬件、驱动程序和操作系统兼容,并通过利用硬件加速器(如适用)以及图形优化和转换,提供最佳性能。ONNX Runtime 训练可以通过对现有 PyTorch 训练脚本的一行添加来加快Transformer模型在多节点 NVIDIA GPU 上的模型训练时间。

主要特点

1.跨平台支持:onnxruntime支持多个操作系统,包括Windows,Linux,macOS,Android和iOS。此压缩包专门针对linux_armv7l平台,即基于ARMv7架构的Linux系统。

2.优化性能:onnxruntime在多个平台上进行了性能优化,包括利用硬件加速器,如GPU和TPU,以提高模型的推理速度。

3.易于部署:onnxruntime旨在简化模型的部署流程,提供了一种轻量级和高效的运行时环境,让模型在生产环境中以最小的开销运行。

4.广泛兼容:支持ONNX格式意味着它可以运行由主流深度学习框架(如TensorFlow,PyTorch,Caffe2,Microsoft Cognitive Toolkit等)导出的模型。

特性

内置优化,可提供高达 17 倍的推理速度和高达 1.4 倍的训练速度

支持多种框架、操作系统和硬件平台

在 Office 365、Visual Studio 和 Bing 中使用,每天提供半万亿次推理

ONNX Runtime推理的示例用例包括

提高各种 ML 模型的推理性能

在不同的硬件和操作系统上运行

在 Python 中训练但部署到 C#/C++/Java 应用程序中

使用在不同框架中创建的模型训练和执行推理

快速启动

安装 ONNX Runtime

你可以通过 pip 安装 ONNX Runtime:

加载和运行模型

以下是一个简单的示例,展示如何加载一个预训练的 ONNX 模型并进行推理:

ONNX Runtime 支持编程语言

C++:ONNX Runtime 原生就是用 C++编写的,如果应用对性能敏感,可以直接调用。

Python:Python API 允许加载 ONNX 模型,可以在不同的计算设备(如CPU, GPU)上运行模型,是被使用最多的语言。

C#:C#的API,使 .NET开发者能够在应用程序中轻松地集成和使用ONNX 模型。

JavaScript:JavaScript库允许在浏览器和 Node.js 环境中运行ONNX模型,使得在Web应用程序中部署机器学习模型变得更加容易。

另外还有 Java WinRT Objective-C Ruby Julia 等语言的支持,覆盖面非常广。